Die Lensa-KI, die jeder verwendet, macht Frauen zu etwas

Technologien der künstlichen Intelligenz, die erhebliche Fortschritte gemacht haben, sind in letzter Zeit populär geworden. Arbeiten, die mit Systemen wie DALL-E und Midjourney erstellt wurden, haben die Internetmedien gefangen genommen. Darüber hinaus gibt es eine Explosion bei den Anwendungen, die die Avatare von Menschen erstellen, und wir sehen diese Bilder, die auf der Grundlage künstlicher Intelligenz entstehen, egal welche Plattform wir besuchen.

Erstellt von Prisma Labs Lensa AI und einer von ihnen. Diese Anwendung, die zu günstigen Preisen genutzt werden kann, heißt „Magic Avatars“. ‚ Es hat eine Funktion namens „Magic Avatars“. Auf diese Weise können Benutzer Avatare erstellen, die wirklich als magisch bezeichnet werden können. Diese Situation zeigt uns jedoch auch ein Problem der künstlichen Intelligenz, wodurch einige Probleme auftreten. Werfen wir einen Blick auf dieses Problem.

Zunächst einmal, was ist diese Lensa-KI? Wie funktioniert es?

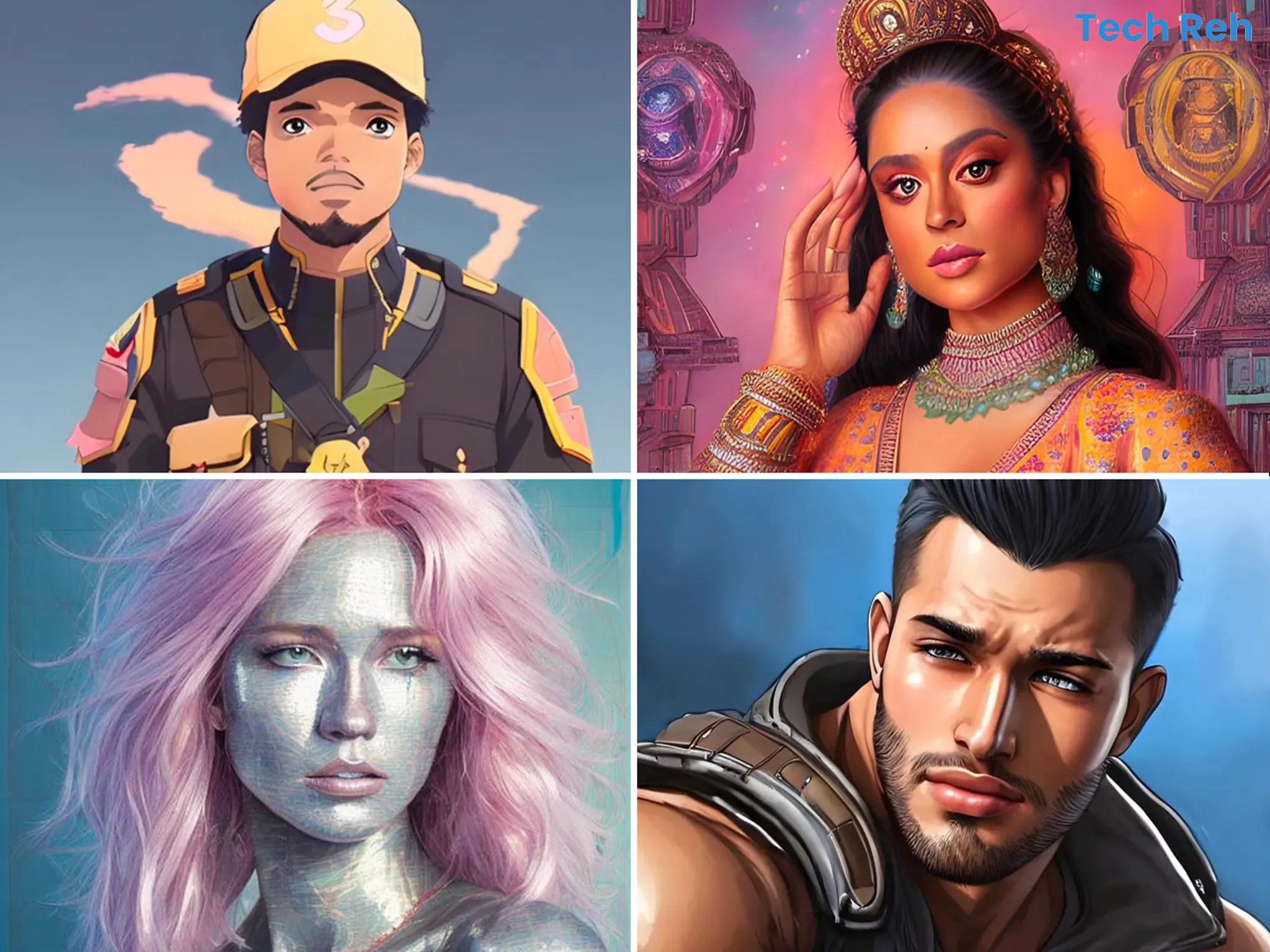

Lensa AI ist, wie bereits erwähnt, eine Anwendung, die von Prisma Labs entwickelt wurde. Lensa, das zuletzt an der Spitze der App-Stores stand, gibt es eigentlich schon seit 2018. Aber Anfang dieses Monats, die ‚ „Magische Avatare“ Funktion machte es bekannt. Mit Preisen ab 88 TL in der Türkei können die Fotos, die Sie zusammen mit diesem durch künstliche Intelligenz verbesserten hinzufügen, in einzigartige Avatare aus verschiedenen Themen (z. B. futuristische oder Anime-Charaktere) umgewandelt werden.

Lensa ist ein Open-Source-Deep-Learning-Modell für künstliche Intelligenz, das eine Datenbank mit Artefakten aus dem Internet nutzt. Stabile Diffusion Verwendet. Diese Datenbank heißt LAION-5B und verwendet 5,85 Milliarden Text-Bild-Paare, die durch das Grenznetzwerk namens CLIP gefiltert werden. Eine neue Version von Stable Diffusion, einem Deep-Learning-Modell, das Bilder aus Text erstellt, das 2022 veröffentlicht wurde, wurde ebenfalls letzten Monat veröffentlicht.

Wenn Sie mehr über Lensa AI und seine Verwendung erfahren möchten, können Sie sich unten unsere Inhalte ansehen.

Lensa AI soll Avatare erstellen, die Frauen objektivieren

Obwohl künstliche Intelligenzsysteme fortgeschritten sind, haben sie immer noch einige Probleme. Das beste Beispiel dafür kann die Tatsache sein, dass künstliche Intelligenzen, die Text in Bild umwandeln, Probleme bei der Erstellung von Händen und Fingern haben. Laut Polygon sieht die Situation in Lensa jedoch etwas anders aus.

Aktuelle Informationen, meine Damen von Lensa AI du hast dich sexualisiert und enthüllte einige rassistische Schlussfolgerungen. Viele Nutzer in den sozialen Medien, Frauen in der Anwendung große Brüste und DekolletéObwohl es keine solche Nachfrage gibt, wenn man sagt, dass es hinzugefügt wurde, sogar Nacktbilder wurden erstelltgemeldet.

Auch Olivia Snow von der University of California schrieb in Wired, dass die App sie am Laufen hielt, selbst wenn sie Fotos aus ihrer eigenen Kindheit hinzufügte. Sexuelles Objekt Er gab an, dass er Bilder erstellt habe, die als gestartet wurden Als die Besitzer der App zu dieser Wette befragt wurden, sagte das Team, dass Snow bewusst gegen die Nutzungsbedingungen verstoßen habe. Die Richtlinien von Lensa verbieten die Verwendung von Bildern von Kindern, während Nacktfotos verboten sind. Gleichzeitig müssen die Nutzer erklären, dass sie über 18 Jahre alt sind.

Laut Benutzern gibt es sogar rassistische Ergebnisse und Nacktheits-Avatare

Tried out the Lensa AI app and fed 20 photos of myself, and I have to say it really struggles with Asian faces. My results were skewed to be more East Asian and I’m absolutely not impressed. pic.twitter.com/WnyLKXQT8K

— Anisa Sanusi (@studioanisa) December 3, 2022

Außerdem soll die App rassistische Stereotype in Avatare einbinden. An den Landschaften, die ein Nutzer mit seinen eigenen Fotos oben erstellt hat, sieht man zum Beispiel, dass künstliche Intelligenz Schwierigkeiten mit asiatischen Menschen hat.

Außer diesem asiatische Frauen fetischisiert werden wird auch berichtet. Eine asiatische Journalistin namens Melissa Heikkilä, die im MIT Technology Review schrieb, teilte ihre Erfahrungen mit der Lensa-Anwendung mit. Dementsprechend wurde ein hohes Maß an Nacktheit in die aus eigenen Fotos erstellten Avatare eingebaut. Der Journalist gab an, dass seine anderen Kollegen dieser stilistischen Situation eher weniger begegnen würden.

Kürzlich wurde auch bekannt, dass diese künstliche Intelligenz ausgetrickst werden kann, um Nacktfotos zu erstellen. Ein von TechCrunch geteilter Bericht ermöglicht es Benutzern, die App einfach zu implementieren. dass Sie Nacktfotos erstellen können , zeigte sogar, dass dies mit Bildern von Prominenten möglich ist. Prisma Labs brachte am 13. Dezember neue Funktionen und gab an, dass sie Avatare erstellen werden, die weniger häufig Sicherheitsbedenken hervorrufen.

„Künstliche Intelligenz ist ein Spiegelbild unserer Gesellschaft“

Was in Lensa passiert ist, zeigt, dass künstliche Intelligenz noch einen langen Weg vor sich hat. Wie bekannt ist, sind einige negative Situationen in diesen Systemen schon oft aufgetreten. In den vergangenen Jahren hat Microsoft seine künstliche Intelligenz namens Tay wegen rassistischer und frauenfeindlicher Äußerungen geschlossen. Kürzlich hat Meta auch ein Sprachmodell aus Beispielgründen geschlossen.

Eine im Juni durchgeführte Studie ergab, dass vom CLIP-Netzwerk trainierte Systeme, die wir in Lensa gesehen haben, Geschlecht und Rasseüber einige Stereotype verriet warum. Außerdem betonte er, dass sie Frauen und Farbige weniger kennen würden.

Wir werden sehen, wie künstliche Intelligenzsysteme, einschließlich Lensa, dieses Problem in Zukunft bewältigen werden. Prisma Labs, der Eigentümer der Anwendung, betont auch, dass Stable Diffusion mit ungefilterten Informationen im Internet arbeitet, und sagt, dass weder sie noch Stable AI (der Schöpfer von Stable Diffusion) etwas dagegen tun können. Er sagte auch, dass die Daten die bestehenden Vorurteile der Menschheit in das Modell einführten. dass künstliche Intelligenz unserer Gesellschaft den Spiegel vorhälter addiert.